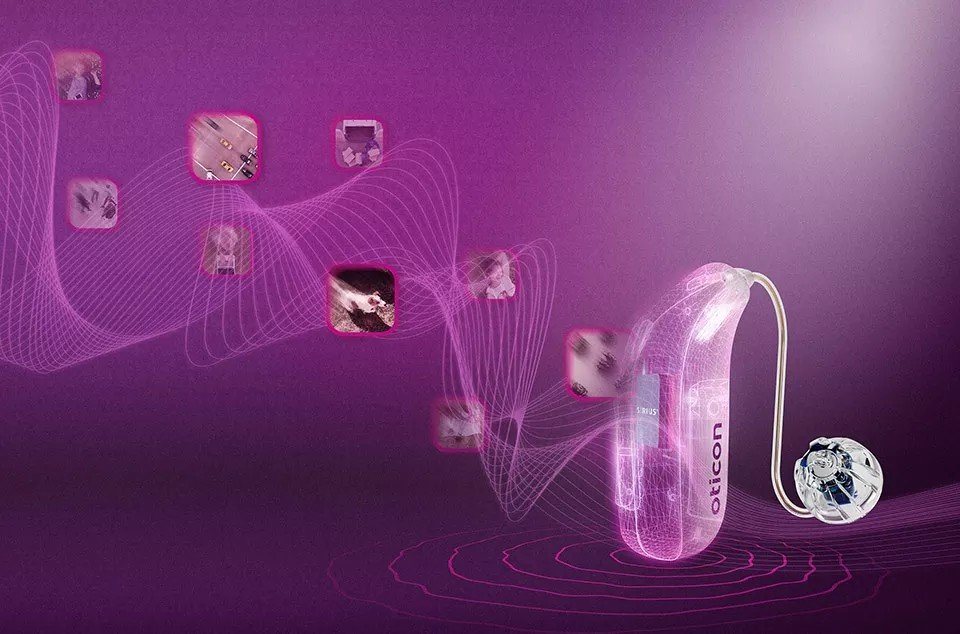

เจาะลึก Deep Neural Network (DNN) ทำไม Oticon ถึงต้องฝึก AI ด้วยเสียงกว่า 12 ล้านฉากทัศน์?

พอกันทีกับระบบตัดเสียงรบกวนแบบเดิมๆ ในอดีต เครื่องช่วยฟังจะใช้วิธี “เดา” ว่าเสียงไหนคือเสียงพูดแล้วขยายเสียงนั้น ส่วนเสียงที่เหลือจะถูก “กด” ให้เบาลง ผลที่ได้คือเสียงที่ฟังดูอึดอัดและไม่เป็นธรรมชาติ แต่ Oticon เปลี่ยนเกมใหม่ด้วยการนำ Deep Neural Network (DNN) มาใช้

DNN คืออะไร? และทำไมต้อง 12 ล้านฉากทัศน์? DNN คือ AI ประเภทหนึ่งที่จำลองการทำงานของโครงข่ายประสาทในสมองมนุษย์ Oticon ได้ทำการบันทึกเสียงจาก “โลกแห่งความเป็นจริง” กว่า 12 ล้านสถานการณ์ ทั้งในร้านอาหารที่วุ่นวาย บนถนน หรือในห้องประชุม แล้วนำมาสอน AI ตัวนี้ให้รู้จักแยกแยะว่า

-

เสียงไหนคือเสียงพูดที่สำคัญ

-

เสียงไหนคือเสียงพื้นหลังที่ช่วยให้รับรู้บรรยากาศ

-

เสียงไหนคือเสียงรบกวนที่ต้องจัดการ

การทำงานที่แม่นยำระดับเสี้ยววินาที เมื่อคุณสวมเครื่องช่วยฟังรุ่นที่มี DNN (เช่น Oticon More หรือ Oticon Real) ชิปประมวลผลจะทำการสแกนเสียงรอบตัวและเปรียบเทียบกับสิ่งที่มันเคยเรียนรู้มา 12 ล้านแบบนั้นตลอดเวลา เพื่อทำการ “จัดระเบียบ” เสียงให้สมองของคุณรับข้อมูลที่แม่นยำที่สุด

การทำงานที่แม่นยำระดับเสี้ยววินาที เมื่อคุณสวมเครื่องช่วยฟังรุ่นที่มี DNN (เช่น Oticon More หรือ Oticon Real) ชิปประมวลผลจะทำการสแกนเสียงรอบตัวและเปรียบเทียบกับสิ่งที่มันเคยเรียนรู้มา 12 ล้านแบบนั้นตลอดเวลา เพื่อทำการ “จัดระเบียบ” เสียงให้สมองของคุณรับข้อมูลที่แม่นยำที่สุด

ประโยชน์ที่คุณจะสัมผัสได้จริง

-

ฟังชัดแม้ในที่เสียงดัง AI จะช่วยดึงเสียงสนทนาให้เด่นออกมาจากเสียงจานชามหรือเสียงดนตรีในร้านอาหาร

-

เสียงมีความเป็นธรรมชาติ คุณจะยังได้ยินเสียงนกร้องหรือเสียงลม โดยที่เสียงเหล่านั้นไม่กวนการสนทนา

-

ไม่เหนื่อยในการฟัง เพราะ AI ทำหน้าที่แยกแยะเสียงให้แล้ว สมองของคุณจึงไม่ต้องทำงานหนักเกินไป